AWS Certified Data Analytics - Specialty 勉強方法

先月、AWS Certified Data Analytics - Specialty を受験し、合格しました。 簡単に勉強方法を記録しておきます。誰かの役に立てば嬉しいです。

AWS Certified Data Analytics - Specialty とは

AWS Certified Data Analytics - Specialty は、試験を通して下記の検証が行われ、合格することで認定を受けることができます。

AWS Certified Data Analytics – Specialty は、AWS のサービスを活用した分析ソリューションの設計、構築、セキュリティ強化、保守に関する経験と専門知識を持つ人を対象としています。この試験を受ける前に、以下のことをお勧めします。 ・一般的なデータ分析テクノロジー分野における 5 年間の経験 ・AWS のサービスを使用して分析ソリューションを設計、構築、保護、および保守する 2 年間の実践的な経験および専門知識 ・AWS データ分析サービスを定義し、それらが相互に統合する方法を理解する能力 ・収集、保管、処理、視覚化のデータライフサイクルに AWS データ分析サービスがどのように適しているかを説明する能力

AWS Certified Data Analytics - Specialty の勉強方法

ドキュメントを読んで覚えるのは個人的に向いていないので、Blackbeltなどサマリされた資料や動画を見ながらポイントをメモしていき、あとは実際にサービスを触りながら気になったところをドキュメントで調べていくというアプローチで進めています。

机上だけの学習で実際に触った時にわからないというカッコ悪い状況にならないことを防ぐ手段でもあります。(現場力が最強だと思っています)

机上で覚える

Google Chromeの翻訳機能を使いながら explore.skillbuilder.aws

[AWS Black Belt Online Seminar] Amazon Athena 資料及び QA 公開 | Amazon Web Services ブログ

[AWS Black Belt Online Seminar] Amazon Redshift 運用管理 資料及び QA 公開 | Amazon Web Services ブログ

https://d1.awsstatic.com/webinars/jp/pdf/services/20191001_BlackBelt_LakeFormation.pdf

触って覚える

下記のハンズオン、ワークショップを実施

aws-glue-hands-on-labs.workshop.aws

Amazon Athena Workshop :: Hands on Labs :: Amazon Athena Workshop

streaming-analytics.workshop.aws

ここから1〜4、7を実施 redshift-immersion.workshop.aws

これは実行はしていなくて読んで流れだけ確認した(コストがかかりそうだったので) redshift-deepdive.workshop.aws

まとめ

Amazon Managed Streaming for Apache Kafkaなど、メインストリームではないだろうサービスは比較となるサービス(Amazon Kinesisなど)との違いを調べたりしましたが、あまり時間をかけて調べたりしませんでした。

あと、Amazon Neptune、Amazon Timestreamなどデータストアの特性をメモ程度に記録しながらサービス概要を斜め読みしています。

全て全網羅的に暗記することは難しいので、ハンズオン、ワークショップで触りながら覚えることで、設定の関連性や、分からない問題でも完全な間違いを消去することで選択肢を絞るなどできます。気にしていなかった設定項目も、問題として出てくると、そういえばどこかで見たことあるな、、、と思い出せたり、手を動かすことで記憶に結びつけることができるので、私は好きな勉強方法です。

今回の受験結果

データレイクを最近専門にやってる同僚のエンジニアに教えてもらったらめっちゃ良い点数取れた。データエンジニアすげえ。 pic.twitter.com/H9sFrc6Jn8

— 山口正徳☁️AWS Samurai(Masanori Yamaguchi) (@kinunori) 2021年7月4日

AWS CodePipeline と Githubアカウント を接続する

Githubに存在するリポジトリ と AWS CodePipeline を連携するために、 AWS CodePipeline と Github を接続する手順のメモ

CodePipelineのコンソールより「接続」をクリック

Githubのアカウントと AWS Connector for Github の信頼関係を設定する確認画面が表示される。「Authorize AWS Connector for Github」をクリック

Githubのアカウントに対し、該当AWSアカウントのCodePipelineと接続するためのアプリケーション登録が必要となる。「新しいアプリをインストールする」をクリック

接続するリポジトリを選択する。All repositories を選ぶと意図しないリポジトリと接続してしまう事故が発生する可能性があるため、「Only select repositories」より、対象のリポジトリを個別に選択する方が良い。

CodePiline Connectorの画面に遷移する。Githubアプリに登録したアプリの名称(おそらく数字数桁になっているはず)が表示されていることを確認し、接続をクリック

接続が正常に作成されたことをメッセージより確認

以上でAWS CodePipeline と Github は完了です。

Github Organizationの管理者が接続作成する人とはロール分離されているなど、All repositoriesを選択したくなる状況があると思いますが、個人環境でない限りはAll repositoriesは選択すべきではないと思います。

JAWS-UG千葉支部で AWS Proton ハンズオンイベントを実施しました

先日、「AWS Proton with ECS のハンズオン手順書を日本語化しました」 というブログを投稿しました。

AWS Proton with ECS のハンズオン手順書を日本語化しました - MY Scribbling

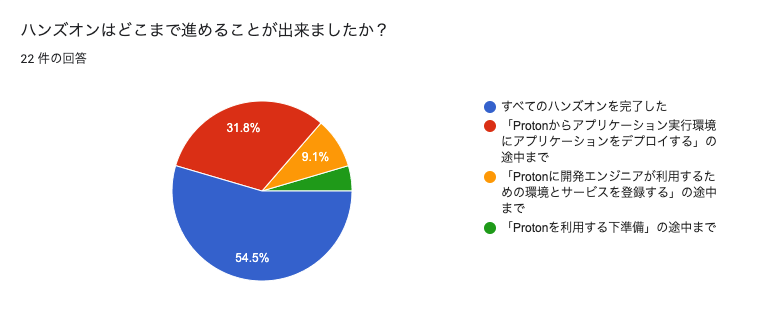

この手順書を利用し、 JAWS-UG 千葉支部で AWS Proton ハンズオンイベントを開催しました。私が講師を行い、76名の方に参加いただきました。ご参加いただいた方、ありがとうございました。

AWS Protonの構築は実行しているリージョンの間違いやCIDR入力など軽微な質問が多く、初めてでも比較的扱いやすいサービスだったのだと思います。AWS Protonの環境削除については、IAMロールの削除順序など少し詰まる方が多かったようです。今後、ハンズオンにも注意などを加筆していこうと思います。

参加いただいた方からのアンケートも満足度の高い回答が多く、今回のハンズオンイベントを企画し、実施した甲斐がありました。

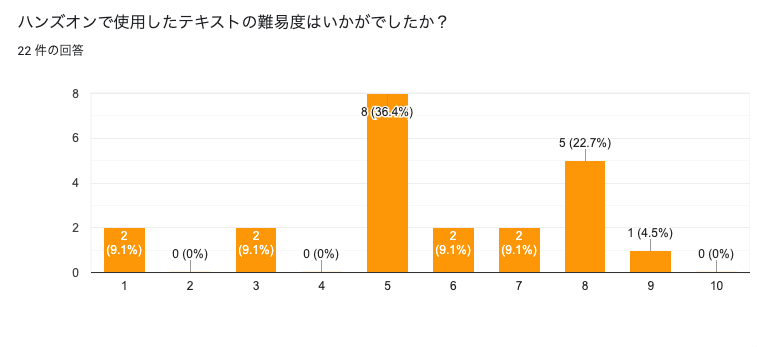

テキストの難易度は少し難しいと感じた方が多かったようです。もう少し書き方を工夫しなければ。(1が易しい、10が難しい)

コメントも温かい内容ばかりでした。ありがとうございます!

- GA直後にキャッチアップできたのですごく助かりました!感謝しかありません!

- 丁寧に解説やフォローをしていただいていてとてもありがたかったです!

- ありがとうございます。新しめのサービスのハンズオンをまたお願いします。

- 難しい内容にもかかわらず、マニュアル作成お疲れ様でした。

- 丁寧な進行で、とても満足感が高かったです。ありがとうございました。次回のハンズオン開催も楽しみにしております!

- ハンズオン中のトラブルにもしっかり対応されている姿が好印象でした。Protonについてもとっかかりの経験はできたのでとても有意義でした。このハンズオンを企画いただき、ありがとうございました。参加してよかったです。

- ハンズオン中の補足説明などがとても勉強になり良かったです!充実した時間を過ごすことができました。いつもありがとうございます。

ハンズオンの講師をすることは、自分の知識の整理や頂いた質問から新しい気づきを得られるので、おすすめです! ということで、イベントも頑張ります!